איך ChatGPT יודע מה לענות?

מבט לעומק על מוחו של הבוט

מבוא

בינה מלאכותית, ובעיקר ChatGPT, חוללה מהפכה של ממש בעולם הדיגיטלי.

בתוך זמן קצר הפך הכלי הזה ממוצר ניסיוני לכלי נפוץ ומובן מאליו במשרדים, אצל תלמידים, מנהלים, מפתחים, יזמים, פנסיונרים, ובקרב כמעט כל מי שחי בעשור הנוכחי.

היכולת לייצר טקסטים, לנסח תשובות, להציע פתרונות, ולהיות "יועץ" דיגיטלי רב-תחומי היא יכולת שלא הייתה קיימת קודם וכעת נדמית כטבעית.

אבל מה באמת קורה מאחורי הקלעים?

כיצד chatbot מסוגל לנהל שיחה מורכבת, לשמור הקשר ולהציג ידע שמאתגר לא אחת גם מומחים אנושיים?

שאלות בנושא חוזרות על עצמן: האם ChatGPT באמת "מבין" אותי?

האם מדובר בבינה או באשליה מתוחכמת?

והאם אפשר לסמוך על התשובות?

במאמר זה תמצאו פירוק למנגנונים הבסיסיים, הצגת תובנות – כולל מגבלות וסיכונים – וראייה ישירה על אחד מכלי הבינה המלאכותית המרכזיים של זמננו.

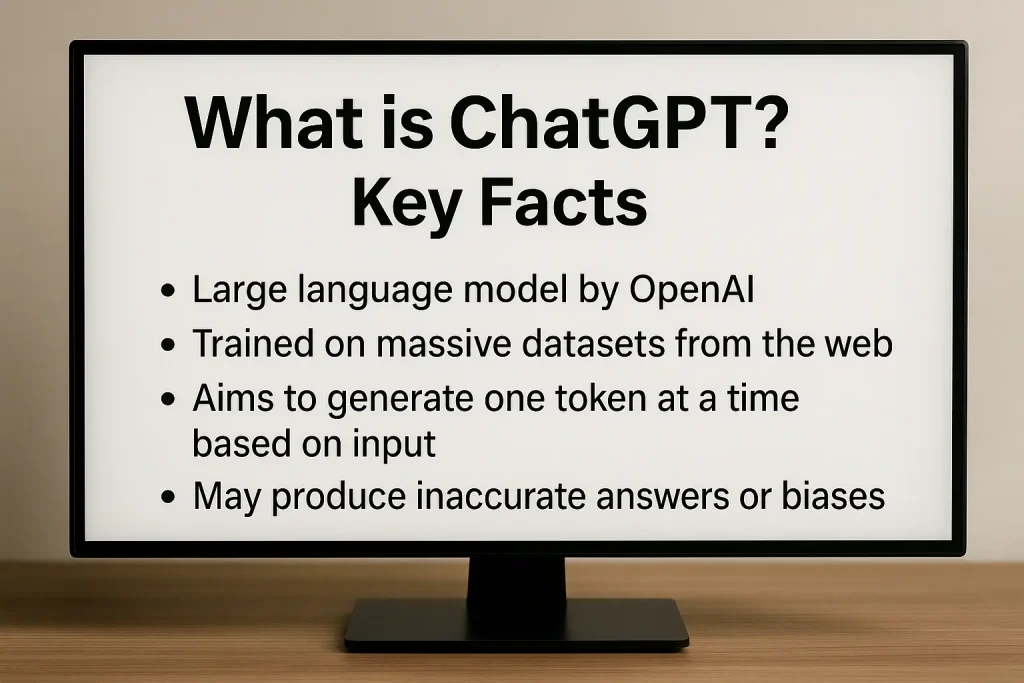

מה זה בעצם ChatGPT? מעבר להייפ – עובדות יסוד

ChatGPT הוא יישום (Application) המבוסס על מודל שפה גדול (LLM – Large Language Model) מבית OpenAI. הרעיון פשוט אך עוצמתי: לאמן מודל מתמטי ענק ש"קרא" כמויות טקסט אדירות – טריליוני מילים ומאות מיליוני מסמכים, כולל ספרים, מאמרי מחקר, כתבות, פוסטים, בלוגים, קוד, דיונים וכתבי יד. המודל מתמודד עם כל צורה של שפה כתובה, ועם הזמן גם עם דיבור, דימויים חזותיים ונתונים מספריים.

בניגוד למה שרבים חושבים, אין כאן "חשיבה" אנושית, ידע מובנה או הבנה. ChatGPT מאומן לזיהוי דפוסים וחוקיות בטקסטים, וכשמוצגת לו שאלה הוא מנבא את הטוקן הבא – הרצף הקטן הבא – על בסיס מה שקדם לו. כל מילה בתשובה נוצרת מתוך הערכה סטטיסטית: מה ההמשך הסביר ביותר לפי השיחה והידע שנצבר באימון.

מאחורי הקלעים: כך פועל המנגנון

נניח ששלחתם ל-ChatGPT שאלה: "איך מכינים עוגת שמרים קלאסית?" מה קורה באותו רגע?

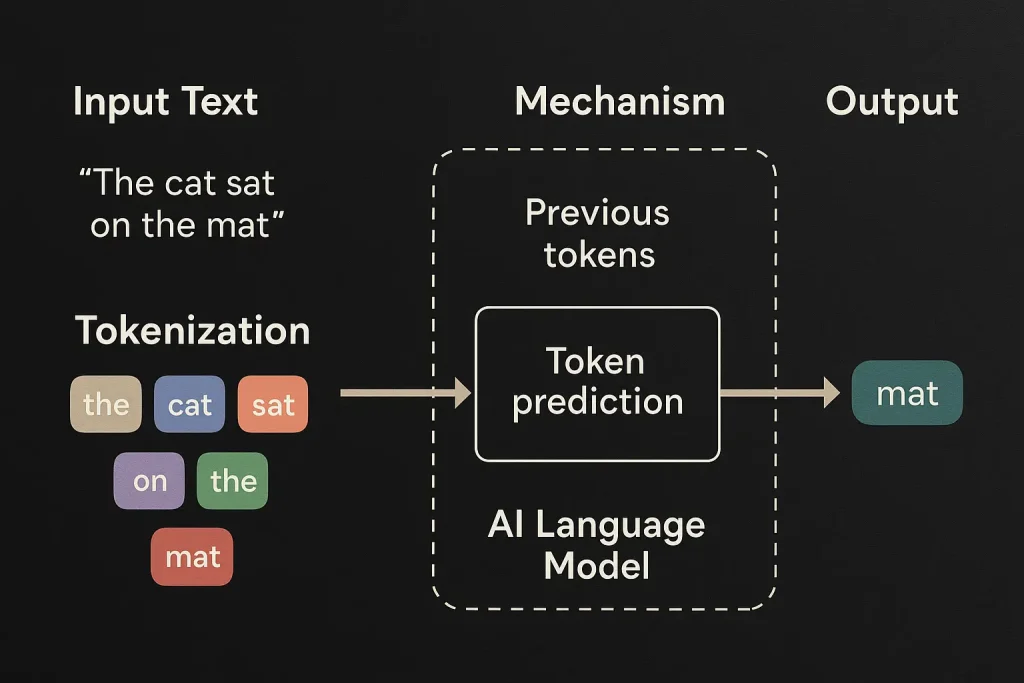

שלב 1: טוקניזציה (Tokenization)

הטקסט מפורק ליחידות קטנות, "טוקנים". אלו יכולים להיות מילים שלמות או רצפים קצרים של תווים. כל טוקן הופך לייצוג מספרי ייחודי.

שלב 2: קידוד הקשר (Contextual Embedding)

כל טוקן, יחד עם ההקשר שלו (הטוקנים סביבו), ממופה לווקטור מספרי במרחב מתמטי רב-ממדי. כך נוצרת תמונה מורכבת של כל השיחה: לא רק השאלה הנוכחית אלא גם דינמיקת השיחה כולה.

שלב 3: Transformer – תשומת לב עצמית (Self-Attention)

הלב של ChatGPT הוא ארכיטקטורת Transformer, ובעיקר מנגנון Self-Attention. במקום לעבור על רצף הטקסט מהתחלה עד הסוף, המודל בוחן את כל הרכיבים יחד, מזהה אילו מהם חשובים ביותר לבניית המשמעות. בהקשר של "איך מכינים עוגת שמרים?", מילות מפתח כמו "מצרכים", "התפחה" ו"אפייה" יקבלו משקל רב יותר.

שלב 4: חיזוי טוקן אחר טוקן (Token Prediction)

המודל פועל שלב אחר שלב: מה הסבירות שהטוקן הבא יהיה "קמח", "סוכר" או "ביצה". כל ניבוי כזה מתבצע שוב ושוב, עד להשלמת המשפט. ההחלטות מבוססות גם על השיח הקודם, סגנון השפה והידע שנצבר.

שלב 5: חזרתיות ובקרה

התהליך חוזר עבור כל טוקן. לפעמים המודל "יפסיק" את התשובה כשהוא חש שההסבר שלם, ולפעמים ימשיך – במיוחד אם המשתמש ביקש פירוט נוסף.

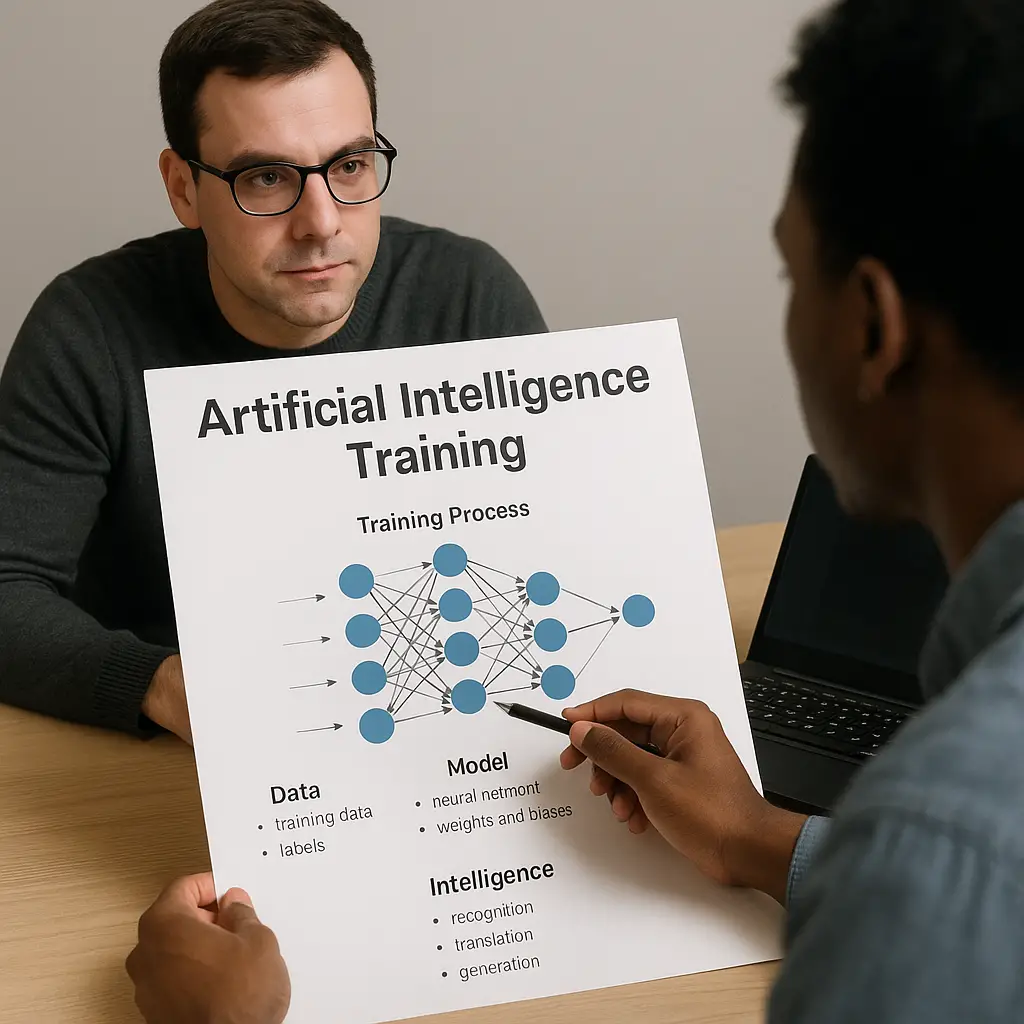

עקרונות האימון – איך יוצרים אינטליגנציה סינתטית?

מודלים מסוג זה עוברים שלושה שלבי אימון עיקריים, שכל אחד מהם מוסיף שכבת הבנה, חוקיות ולעיתים גם גוון רגשי:

1. למידה לא מפוקחת (Unsupervised Learning)

המודל "שואב" מאות מיליארדי פסקאות מתוך מטרה לזהות חוקים ודפוסים. הוא לא מחפש תשובה "נכונה", אלא את ההמשך הסביר ביותר.

2. כיוונון אנושי (Human Fine-Tuning)

בני אדם בוחנים תשובות, מדרגים ומשמשים כשופטים. כך לומד המודל מהי תשובה טובה – מדויקת, ברורה, אדיבה ועניינית – ומהי תשובה גרועה או מסוכנת.

3. למידה מחיזוקים

בשלב זה המודל מקבל "תגמול" או "עונש" בהתאם לתשובה שהפיק. האלגוריתם מתעדף תשובות איכותיות, מסנן תשובות לא רצויות ובונה סטנדרט שיחה גבוה יותר.

מה ChatGPT יודע – ומה לא? מגבלות, טעויות והזיות

הדיוק והיכולת לשמור הקשר יוצרים אשליה של אינטליגנציה עמוקה.

בפועל, המערכת עיוורת למשמעות אמיתית: היא אינה מבינה רגשות, לא "חווה" את העולם, ולא יכולה לבדוק אם מה שאמרה נכון – אלא אם המידע קיים במאגר עליו אומנה.

שלוש מגבלות יסוד

ידע לא עדכני: ברירת המחדל של ChatGPT היא עבודה על בסיס ידע שנאסף עד מועד סיום האימון שלו, והוא אינו מעודכן אוטומטית מהאינטרנט, למעט בגרסאות מסוימות או בהפעלה של יכולת Browsing או חיבור לכלים חיצוניים.

בחשבון החינמי, יש גישה לפיצ'ר זה רק אם מצוין מפורשות שהמודל מחובר לרשת. לרוב, תשובותיו מבוססות על מאגר הידע שברשותו בעת האימון – ולכן יש לו מגבלה לגבי אירועים, חדשות או נתונים דינמיים מהעת האחרונה.הזיות (Hallucinations): לעיתים המודל ימציא עובדות, שמות או מקורות שלא קיימים – הוא מעדיף "להיראות חכם" מאשר להודות בחוסר ידע.

הטיות (Biases): המודל סופג דעות קדומות, הטיות ואפילו שגיאות מהחומר עליו אומן.

ככל שהאינטרנט בעייתי, כך גם תשובות המודל עלולות להיות.

מגבלה נוספת: אמינות סגנונית

המודל מיטיב לחקות סגנון, אך אין לו "כוונה".

הוא מסוגל להפיק טקסטים משעשעים, מקצועיים, ציניים או פורמליים – אך פועל רק על פי הדפוסים שספג.

עומק הסגנון: כך ChatGPT מתאים את עצמו לשיחה

אחת היכולות המרשימות של המודל היא גמישותו הסגנונית.

בעידן הפרסונליזציה, ChatGPT "לומד" את המשתמש מתוך השאלות וההקשר, מתכתב עם אוצר המילים, סגנון, רמת פורמליות, הומור, ולעיתים אף רפרנסים תרבותיים.

כך נוצרת תחושת שיחה אמיתית – אך מדובר באלגוריתם, לא באדם.

דוגמאות לסגנון:

בשאלה מקצועית תתקבל תשובה עם הפניות, מקורות והגדרות.

בדיאלוג יומיומי, השפה תהיה קלילה וכוללת סלנג.

בהסבר לילד, הטון פשוט וכולל דוגמאות.

בבקשות עם דרישת הומור, תשלב התשובה משחקי מילים.

כל אלה מבוססים על דפוסי שפה, לא על הבנה אמיתית.

איך למצות את המקסימום מהמודל?

כמי שעוסק ב-AI ובאוטומציה, אלו הכלים המעשיים ביותר:

1. היו ברורים וממוקדים

אל תצפו שהמודל "יבין בין השורות". שאלו שאלות מדויקות, פרטו מטרה וקבעו פורמט – כך תקבלו תשובה איכותית.

2. שלבו דוגמאות

בקשו: "הסבר X לילד בן 10", "השוואה בטבלה", "דוגמה מהחיים". שאלה עשירה משפרת את התשובה.

3. גבשו רצף בשיחה

המשיכו בשאלות המשך, בקשו תיקונים, הוסיפו פרטים. היכולת לשמור הקשר היא עוצמתית.

4. דרשו ציון מגבלות

בקשו שהמודל יסייג, יפנה למקורות או יציין מגבלות מידע.

5. נסחו מחדש בקשות מסובכות

אם לא קיבלתם תשובה מספקת – נסחו מחדש. שינוי קל בניסוח משנה תוצאה.

מגמות עתידיות: הבינה המלאכותית של המחר

התחום מתפתח במהירות, ולעיתים בקצב שקשה לעקוב אחריו. מה צפוי לנו?

שילוב בזמן אמת עם מאגרי מידע חיים.

הבנה מעמיקה של הקשר תרבותי, רגשות ואירוניה.

כלים מתקדמים להפרדה בין עובדות לבדיות.

אינטגרציה בין מודלי שפה, ראייה ממוחשבת (Vision), וכלים קוליים – לממשק הוליסטי.

מערכות בקרה אתיות, שקיפות והתרעה על מידע בעייתי.

בינה מלאכותית בשירות האדם – לא תחליף לאנושיות

ההתפעלות מיכולותיו של ChatGPT וכלים דומים עלולה להטעות, אך חשוב להעמיד דברים על דיוקם: שום מערכת אוטומטית לא מסוגלת להחליף שיקול דעת מקצועי, חשיבה ביקורתית עמוקה או יצירתיות אנושית אמיתית. כל מי שרואה בבוטים הללו מקור בלעדי לידע או פתרונות – מסכן את עצמו בטעות, בהטעיה או באשליה. התייחסו אל ChatGPT כאל כלי עזר בלבד, שמסוגל להעשיר ולהאיץ תהליכים – אך בשום אופן לא כתחליף להכרעה אנושית. הערך האמיתי יופק רק אם תקפידו לסנן, לבדוק, להצליב ולשלוט במידע – ולא להיגרר אחרי תחושת כל-יודע מזויפת.

סיכום: לנהל דיאלוג חכם עם ChatGPT

בסופו של דבר, מי שמסוגל לשאול את השאלות הנכונות – מי שמבין מה לדרוש מהמערכת, יודע להדגיש עקרונות, ומקפיד להטיל ספק – הוא זה שמפיק את הערך הרב ביותר משימוש ב-ChatGPT.

היכולת להפעיל בינה מלאכותית אינה נמדדת רק באיכות התשובה, אלא במיומנות המשתמש לנתב את הדיאלוג, לבדוק, להצליב ולבקר את המידע.

ChatGPT הוא לא פחות מאשר מהפכה טכנולוגית, כלי עזר רב-עוצמה שמסוגל להעצים, להאיץ, לפשט תהליכים ולשחרר אותנו מעיסוקים שגרתיים – אך בשום אופן אינו תחליף לשיקול דעת וחשיבה אנושית עצמאית.

רק כאשר משלבים הבנה של המנגנון, בונים מיומנות שאילת שאלות, שומרים על עקרונות אתיים ופועלים באופן ביקורתי – הופך ChatGPT לכלי משנה מציאות אמיתי.

הגיע הזמן להפסיק להיות משתמשים פסיביים – ולהפוך למשתמשים חכמים.

אני מזמין אתכם לבחון בעצמכם, להתנסות, לאתגר את ChatGPT במגוון תחומים, לגלות בעצמכם את יתרונותיו ומגבלותיו. מי שיבחר ללמוד, להעמיק ולשלוט בכלי – יוכל להוביל, לחדש ולהפיק ערך יוצא דופן בעידן הדיגיטלי. אל תסתפקו בתשובות שטחיות – תהיו אלה שמובילים את הדיאלוג, לא נגררים אחריו.

רוצים להעמיק? פנו אליי לייעוץ, הדרכה אישית, או הכשרה קבוצתית לשימוש חכם ויעיל בכלי הבינה המלאכותית של דור העתיד.