אשליית האינטליגנציה: איך קלוד פתאום נהיה פחות חד!

ומה אנחנו יכולים ללמוד מזה

בתחילת מרץ 2026, קרה משהו מוזר בקהילת המפתחים.

משתמשים כבדים ב-Claude Code, כאלו שרגילים לסמוך על המודל בעיניים עצומות למשימות הכי מורכבות שלהם, החלו להרגיש שמשהו "חורק".

זה לא שהמודל הפסיק לעבוד לגמרי, אלא שהוא פשוט נהיה פחות מבריק.

הוא התחיל לספק פתרונות שטחיים, לשכוח על מה דיברו לפני רגע, ולבצע טעויות לוגיות שבדרך כלל היו קטנות עליו.

ב-23 באפריל, חברת Anthropic עשתה צעד אמיץ ופרסמה "פוסט-מורטם" (ניתוח שלאחר מוות) הנדסי ומפורט להפליא.

המסקנה שלהם הייתה מטלטלת:

האינטליגנציה של המודל עצמו נשארה בדיוק אותו דבר, אבל "המעטפת" שלו (מה שהם קוראים לו The Harness) פשוט התפרקה בשלוש נקודות שונות.

כיועץ AI, אני תמיד אומר ללקוחות שלי: המודל הוא רק המנוע של המכונית.

אם תיבת ההילוכים שלכם דפוקה או שהצמיגים מפונצ'רים, המכונית לא תגיע לשום מקום, גם אם יש לה מנוע של פרארי עם 1,000 כוחות סוס.

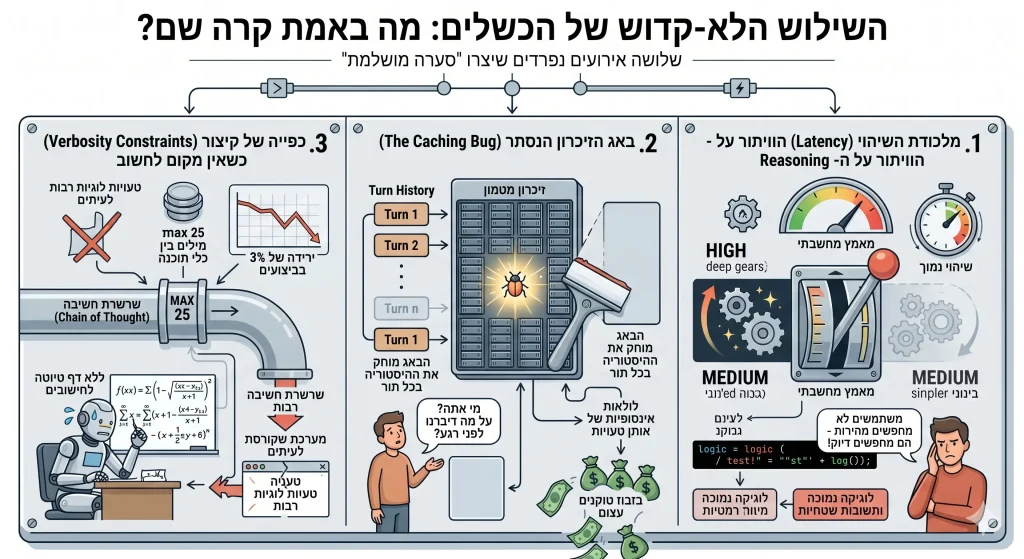

השילוש הלא-קדוש של הכשלים: מה באמת קרה שם?

הפוסט-מורטם חושף שהיו כאן שלושה אירועים נפרדים שקרו כמעט במקביל.

השילוב ביניהם יצר "סערה מושלמת" שהיה קשה מאוד לעלות עליה בזמן אמת.

בואו נצלול פנימה:

1. מלכודת השיהוי (Latency) – הוויתור על ה- Reasoning

הכל התחיל ב- 4 במרץ. הצוות ההנדסי של Anthropic קיבל החלטה שנראתה אז מאוד הגיונית:

להוריד את רמת המאמץ המחשבתי (Reasoning Effort) של Claude מ-"High" ל-"Medium".

למה הם עשו את זה? כי הם רצו שהמשתמשים יקבלו תשובות מהר יותר.

בעולם ה- AI, מהירות היא שם המשחק, וכולם רוצים "שיהוי נמוך" (Low Latency).

הביקורת שלי:

זו טעות קלאסית של ניהול מוצר.

כשמדובר במשימות מורכבות כמו כתיבת קוד או ניתוח נתונים, המשתמשים לא מחפשים מהירות – הם מחפשים דיוק!

אם מפתח צריך לחכות עוד 5 או 10 שניות כדי לקבל קוד שעובד במכה ראשונה, הוא יעשה את זה בשמחה.

ברגע שהורידו את רמת ה-Reasoning, המודל פשוט התחיל "לחפף". הוא לא העמיק בלוגיקה, והתוצאה הייתה ירידה מיידית באיכות.

המדדים הפנימיים של החברה הראו שהמערכת מהירה יותר, אבל הם פספסו את העובדה שהיא נהייתה הרבה פחות מועילה.

2. באג הזיכרון הנסתר (The Caching Bug)

ב-26 במרץ, הוכנסה אופטימיזציה למערכת ה- Caching (הזיכרון המטמון) של המודל.

המטרה הייתה לחסוך בעלויות הזיכרון היקרות בשרתים.

אבל, באג קטן בקוד גרם לתקלה גדולה: המערכת פשוט מחקה את "היסטוריית החשיבה" של המודל בכל תור (Turn) של השיחה.

תדמיינו שאתם יושבים בישיבת צוות ארוכה וחשובה. בכל פעם שמישהו אחר מתחיל לדבר, אתם פתאום שוכחים את כל מה שנאמר בחצי השעה האחרונה.

אתם עדיין שם, אתם עדיין עונים לשאלות, אבל אתם חסרי הקשר לחלוטין.

זה בדיוק מה שקרה לקלוד.

הוא המשיך לבצע פעולות, אבל בלי להבין למה הוא עושה אותן.

זה הוביל למצבים אבסורדיים שבהם המודל נכנס ללולאות אינסופיות של אותן טעויות, מה שגרם למשתמשים לבזבז המון כסף על טוקנים (Token usage) בלי לקבל תוצאה.

3. כפייה של קיצור (Verbosity Constraints) – כשאין מקום לחשוב

הכשל האחרון הגיע ב- 16 באפריל.

Anthropic עדכנה את ה- System Prompt (ההנחיות הבסיסיות שהמודל מקבל לפני שהוא מדבר איתכם) ודרשה ממנו להיות תמציתי וקצר יותר – עד 25 מילים בין קריאה לכלי תוכנה אחד לשני.

התוצאה:

ירידה של 3% בביצועים במבחנים הרשמיים. אולי 3% נשמע לכם מעט, אבל בעולם של בינה מלאכותית, זה לעיתים ההבדל בין קוד שרץ חלק לבין מערכת שקורסת.

בגלל שהמודל הוגבל במספר המילים, הוא לא יכול היה "לחשוב בקול רם" (Chain of Thought).

כשאין למודל מקום לבטא את הלוגיקה שלו לפני שהוא נותן תשובה, הוא פשוט נוטה לטעות הרבה יותר.

זה כמו לבקש ממתמטיקאי לפתור משוואה מסובכת בלי לתת לו דף טיוטה לחישובים.

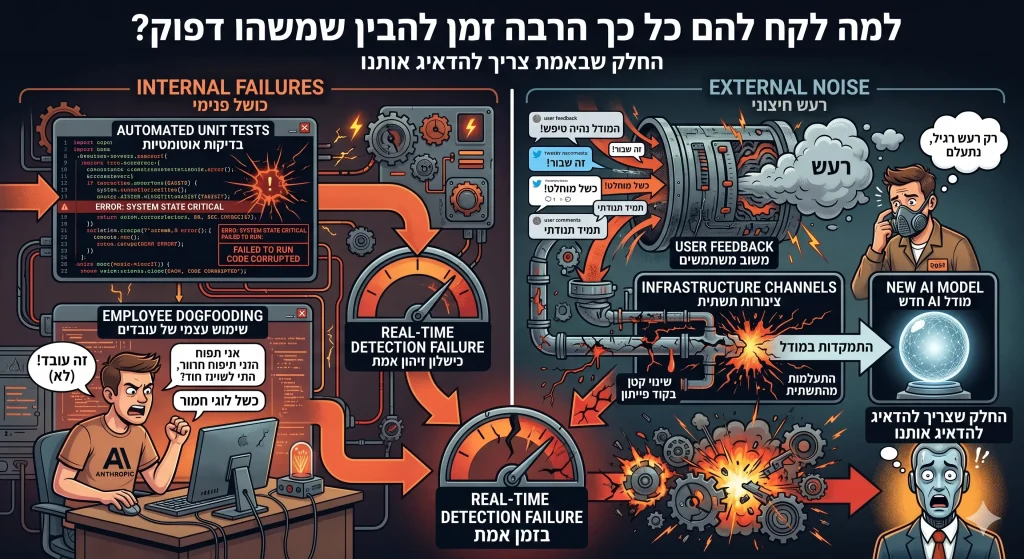

למה לקח להם כל כך הרבה זמן להבין שמשהו דפוק?

זה החלק שבאמת צריך להדאיג אותנו.

Anthropic מודה שהבדיקות האוטומטיות הרגילות שלהם (Unit Tests) וגם השימוש העצמי של העובדים במוצר (Dogfooding) פשוט לא זיהו את ההתדרדרות בזמן אמת.

הסיבה העיקרית היא "רעש":

משוב ממשתמשים הוא תמיד דבר תנודתי.

תמיד יהיו כאלו שמתלוננים שהמודל "נהיה טיפש", גם כששום דבר לא השתנה.

בגלל זה, המהנדסים נטו להתעלם מהתלונות הראשונות.

בנוסף, הכשלים לא היו במודל עצמו אלא ב"צינורות" שמסביב.

רוב חברות ה- AI מתמקדות בבדיקת המודל החדש שהן אימנו, אבל הן שוכחות לבדוק איך שינוי קטן בקוד ה- Python של התשתית יכול להרוס הכל.

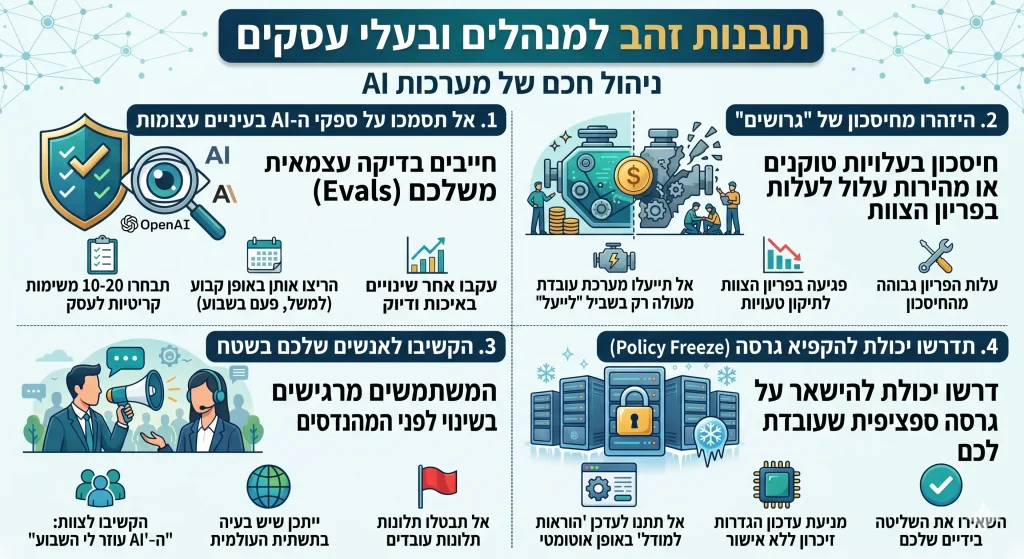

תובנות זהב למנהלים ובעלי עסקים

אם אתם מנהלים מערכות AI בארגון שלכם, או שוקלים להטמיע "סוכנים חכמים", הנה כמה דברים שאתם חייבים לקחת מהסיפור הזה:

1. אל תסמכו על ספקי ה-AI בעיניים עצומות:

אפילו הענקים כמו Anthropic עושים טעויות של מתחילים.

אתם חייבים שתהיה לכם מערכת בדיקה עצמאית משלכם (Evals).

תבחרו 10-20 משימות קריטיות לעסק שלכם ותריצו אותן פעם בשבוע כדי לראות אם האיכות השתנתה.

2. היזהרו מחיסכון של "גרושים":

אם המערכת שלכם עובדת מעולה, אל תרוצו "לייעל" אותה כדי לחסוך כמה סנטים בעלויות של טוקנים או כמה שניות במהירות התגובה.

לפעמים החיסכון הזה יעלה לכם בפריון עבודה של צוות שלם שיצטרך לתקן טעויות של ה- AI.

3. הקשיבו לאנשים שלכם בשטח:

המשתמשים בקהילה הרגישו בשינוי שבועות לפני שהמהנדסים הודו בו.

אם העובדים שלכם אומרים לכם "ה- AI פחות עוזר לי השבוע", אל תבטלו את זה. יכול להיות שיש בעיה בתשתית העולמית שמשפיעה עליכם.

4. תדרשו יכולת להקפיא גרסה (Policy Freeze):

אחד הלקחים החשובים מהאירוע הוא שצריך לדרוש מהספקים את היכולת להישאר על גרסה ספציפית שעובדת לכם.

אל תתנו להם לעדכן לכם את ה"הוראות למודל" או את הגדרות הזיכרון בלי שתאשרו זאת מראש.

המבט הביקורתית שלי: האם זה באמת היה בטעות?

Anthropic מדברים הרבה על שקיפות, וזה יפה.

אבל בואו נהיה רגע סקפטיים:

האם מדובר רק בטעות הנדסית, או בניסיון שקט להוריד עלויות מחשוב (Compute) שפשוט "נתפס"?

חברות ה- AI שורפות היום מיליארדי דולרים על חשמל ושרתים.

הפיתוי להוריד קצת את רמת הדיוק כדי לחסוך מיליונים בעלויות תפעול הוא עצום.

הלקח עבור כולנו הוא פשוט:

הבינה המלאכותית היא כלי מדהים, אבל היא עדיין שבירה מאוד.

היא תלויה בשרשרת אספקה מורכבת של קוד, שרתים והנחיות אנושיות.

משמעת הנדסית היא לא רק המלצה למי שרוצה להיות מוביל שוק – היא תנאי בסיסי לשרידות של העסק שלכם בעידן החדש.